《天池龙珠 - 机器学习训练营》01.机器学习算法:基于逻辑回归的分类预测 学习笔记

一、学习知识点概要

1.1 逻辑回归模型的介绍

逻辑回归(Logistic regression,简称LR)虽然其中带有”回归”两个字,但逻辑回归其实是一个分类模型,并且广泛应用于各个领域之中。虽然现在深度学习相对于这些传统方法更为火热,但实则这些传统方法由于其独特的优势依然广泛应用于各个领域中。

而对于逻辑回归而且,最为突出的两点就是其模型简单和模型的可解释性强。

逻辑回归模型的优劣势:

优点:实现简单,易于理解和实现;计算代价不高,速度很快,存储资源低; 缺点:容易欠拟合,分类精度可能不高

1.2 代码实现流程

这里主要分为两部分。一部分使用手动输入的一组坐标点进行训练学习,掌握scikit-learn库中逻辑回归模型的基本使用方法和函数(方法)的使用;第二部分是导入了经典的鸢尾花数据集,然后对其进行二分类、多分类模型的训练和预测。 其中代码实现流程中,采用了一些可视化的库,将数据花在图表中,数据更加直观。

二、学习内容

由于本科阶段学习过相关内容,本次为复习,所以只简单概述复习中学习或者值得注意的地方,本专栏的后面博客内容也都是如此,后面就不赘述。

导入逻辑回归模型库是从sklearn的linear_model包下导入LogisticRegression。 首先创建LogisticRegression实例lr_clf,接着通过fit方法训练数据集,通过coef_方法查看对应模型的w,通过intercept_方法查看对应模型的w~0~。多分类模型也是如此。通过metrics.accuracy_score来计算预测的准确度。 Logistic 函数的特性和取值。

三、学习问题与解答

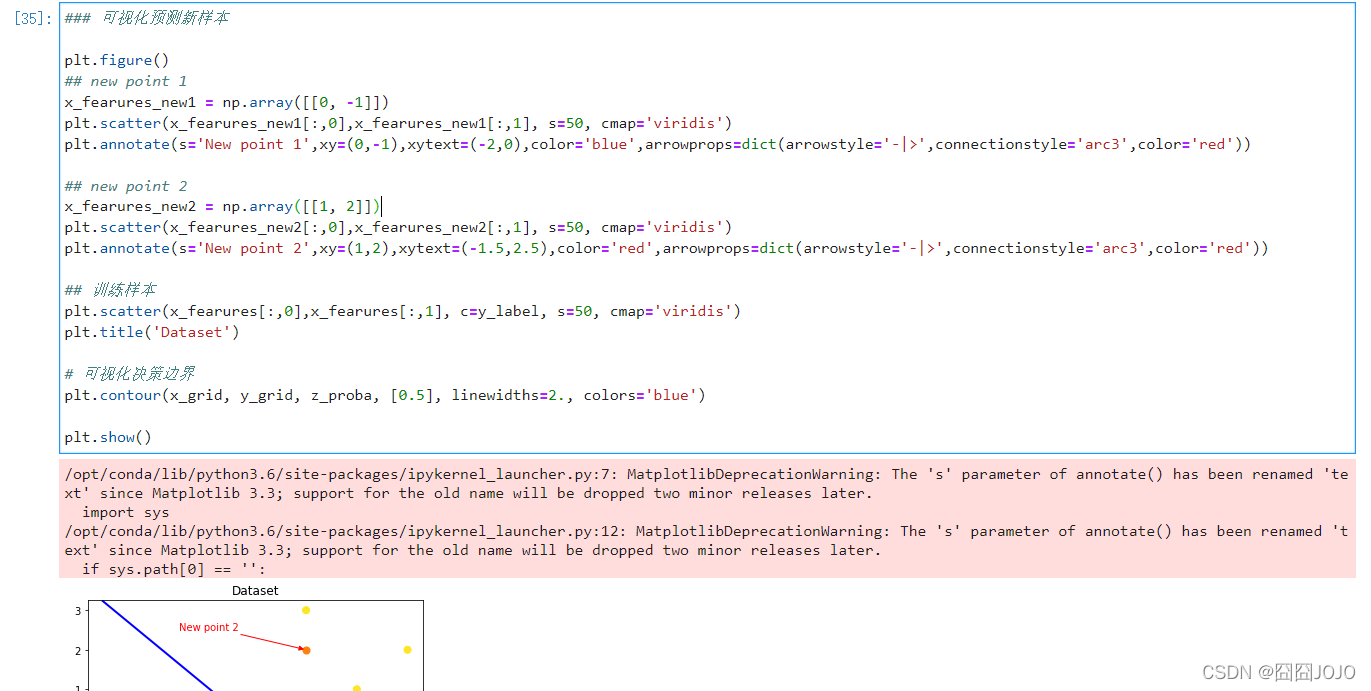

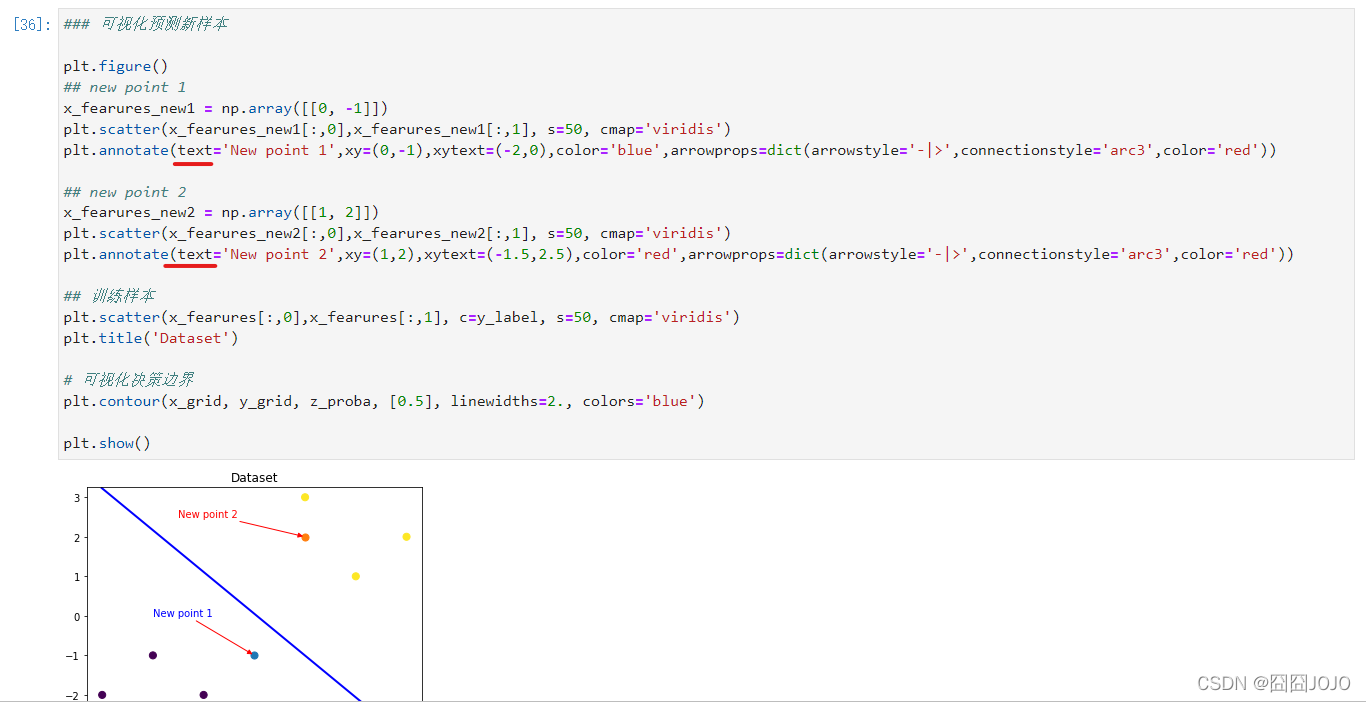

【问题描述】: 这里遇到了一个问题,通过官方的notbook文档执行,可以看到 可视化预测新样本 时会抛出一个错误提示:  【解决方案】: 由于版本迭代的问题,参数

【解决方案】: 由于版本迭代的问题,参数s已经不再使用,更改为text就不会出现问题。

四、学习思考与总结

本节让我回顾了本科学习的机器学习逻辑回归模型,回顾了scikit-learn库的使用,同时,之前没有使用过coef_和intercept_方法,在本次学习中,了解和掌握了查看训练模型模拟出的w和w~0~的方法。 同时回顾了可视化数据的展示方法。收获满满~